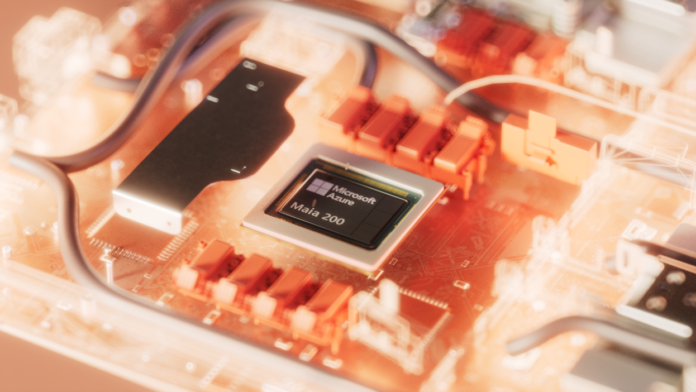

Microsoft ประกาศเปิดตัว “Maia 200” ชิปเร่งการประมวลผล AI สำหรับงานอินเฟอเรนซ์รุ่นล่าสุด เดินหน้าวางมาตรฐานใหม่ให้โครงสร้างพื้นฐาน AI ระดับคลาวด์ โดยออกแบบมาเพื่อรองรับโมเดล AI ขนาดใหญ่ที่มีความซับซ้อนสูง เน้นทั้งประสิทธิภาพ ความคุ้มค่า และการปรับขนาดในระดับดาต้าเซ็นเตอร์

Maia 200 ถูกพัฒนาขึ้นเพื่อเป็นหัวใจของโครงสร้างพื้นฐาน AI บน Microsoft Azure ช่วยเพิ่มขีดความสามารถในการรันเวิร์กโหลดอินเฟอเรนซ์จำนวนมาก พร้อมลดต้นทุนการประมวลผลต่อหน่วย (perf/$) ลงอย่างมีนัยสำคัญ เหมาะกับการใช้งาน AI ในระดับองค์กรและบริการคลาวด์ขนาดใหญ่

ชิป Maia 200 ผลิตด้วยกระบวนการ 3 นาโนเมตรจาก TSMC ภายในประกอบด้วยทรานซิสเตอร์มากกว่า 100,000 ล้านตัว รองรับการประมวลผลแบบ FP4 ได้มากกว่า 10 PetaFLOPS และ FP8 ราว 5 PetaFLOPS ช่วยให้สามารถรันโมเดล AI ขั้นสูงได้อย่างรวดเร็ว และรองรับสเกลของโมเดลในอนาคต

ด้านระบบหน่วยความจำ ไมโครซอฟท์ออกแบบใหม่ทั้งหมดเพื่อลดปัญหาคอขวดของการส่งข้อมูล โดยใช้ HBM3e ความจุ 216GB แบนด์วิดท์สูงถึง 7 TB/s เสริมด้วย on-chip SRAM ขนาด 272MB และ Data Movement Engine ที่ช่วยให้โมเดลขนาดใหญ่สามารถรับส่งข้อมูลได้ต่อเนื่องและมีประสิทธิภาพสูง ผลลัพธ์คือประสิทธิภาพต่อราคาที่ดีกว่าระบบเดิมราว 30% ซึ่งทำให้ Maia 200 กลายเป็นระบบอินเฟอเรนซ์ที่ทรงพลังที่สุดที่ไมโครซอฟท์เคยนำมาใช้งาน

Maia 200 ยังรองรับ Dedicated Scale-Up Bandwidth สูงสุด 1.4 TB/s และสามารถขยายการทำงานในคลัสเตอร์ขนาดใหญ่ได้ถึง 6,144 ตัว เหมาะสำหรับคลัสเตอร์อินเฟอเรนซ์ความหนาแน่นสูง ช่วยลดการใช้พลังงานและต้นทุนรวมในการเป็นเจ้าของ (TCO) ของดาต้าเซ็นเตอร์ พร้อมผสานเข้ากับ Azure Control Plane เพื่อการจัดการ ความปลอดภัย และการมอนิเตอร์ในระดับชิปและระดับแร็ค

ด้วยแนวทางการพัฒนาแบบครบวงจรตั้งแต่ชิป ซอฟต์แวร์ระบบ ไปจนถึงการใช้งานจริงในดาต้าเซ็นเตอร์ ไมโครซอฟท์สามารถลดระยะเวลาจากความพร้อมของซิลิคอนไปสู่การใช้งานจริงได้อย่างชัดเจน ทำให้โมเดล AI เริ่มทำงานบน Maia 200 ได้เร็วขึ้น และช่วยเพิ่มประสิทธิภาพทั้งด้านต้นทุนและพลังงานในระดับคลาวด์

ปัจจุบัน Maia 200 ถูกนำไปใช้งานแล้วในโครงสร้างพื้นฐานคลาวด์ของไมโครซอฟท์ทั่วโลก โดยเริ่มจากทีม Microsoft Superintelligence สำหรับการสร้างข้อมูลสังเคราะห์และการเรียนรู้แบบเสริมกำลัง (Reinforcement Learning) เพื่อปรับปรุงโมเดลภายในองค์กร รวมถึงการขับเคลื่อนเวิร์กโหลด AI ใน Microsoft Foundry และ Microsoft 365 Copilot และมีแผนเปิดให้ลูกค้าใช้งานอย่างกว้างขวางยิ่งขึ้นในอนาคต

นอกจากนี้ ไมโครซอฟท์ยังเปิดให้ลงทะเบียนทดลองใช้ Maia SDK สำหรับนักพัฒนา นักวิชาการ และผู้ร่วมโครงการโอเพนซอร์ส โดยชุดพัฒนานี้ประกอบด้วย Triton Compiler, PyTorch และ Maia Simulator เพื่อช่วยให้สามารถปรับแต่งโมเดลและเวิร์กโหลด AI ได้อย่างมีประสิทธิภาพมากขึ้น

ติดตามข่าวสารอัปเดตวงการเทคโนโลยี เกม และไลฟ์สไตล์เพิ่มเติมได้ที่ techcatchup.net

พร้อมช่องทางโซเชียล Facebook | Instagram | TikTok | YouTube | X